Von der Idee zur Visualisierung – und zum Objekt

Jedes Produkt wurde begleitet von:

Poster-Visualisierung (KI-Generationen + ggf. finale CAD/Render-Ergebnisse)

Prompts & Iterationsdokumentation

Skizzen & Prozessschritte

KI-generierten Video-Clips (als Inszenierung/Commercial/Animation)

Workflow in der Praxis

Ein zentraler Teil des Projekts war nicht nur die Generierung von Produktdesigns und Visuals, sondern die Entwicklung eines wiederholbaren Kreativprozesses. Der tatsächliche Ablauf lief in den meisten Fällen so:

1. Moodboard als kreative Ausgangsbasis

Statt direkt „ins Prompten" zu springen, wurde zuerst ein Moodboard erstellt: Materialien, Lichtstimmungen, Set-Design-Referenzen, Bildsprache (Studio vs. Lifestyle), Kamerawinkel, Farbklima, ggf. Markenassoziationen. Dieses Moodboard funktionierte als visuelle Sprache, die später in Text übersetzt werden musste.

2. Sprachliche Übersetzung in Prompts

Der Moodboard-Input wurde in Prompts übertragen: Materialdefinition, Oberfläche/Finish, Szene/Umgebung, Licht, Perspektive, Objektmaßstab, Stilvokabular, ggf. technische Parameter (z. B. „8k", „studio lighting", „top-down").

3. Erste Generationsrunde: breit statt präzise

Zu Beginn wurden Prompts häufig händisch geschrieben – eher intuitiv und explorativ. Diese Phase diente dazu, „Range" zu erzeugen: viele Varianten, um zu sehen, wie das Modell reagiert und welche Richtungen überhaupt entstehen können.

4. Learning Curve: Prompts mit ChatGPT verfeinern

Aus der Lernkurve ergab sich eine klare Erkenntnis: Die höchste Qualität entsteht, wenn die Prompts systematisch werden. ChatGPT wurde genutzt, um Prompts zu strukturieren (modular, wiederverwendbar), Begriffe präziser zu formulieren (Material, Licht, Kamera), Inkonsistenzen zu entfernen, und „Prompt-Dialekte" zu treffen (die Formulierungen, auf die das jeweilige Modell besonders gut reagiert).

5. Iterationen & Referenzbilder (wo nötig)

Da KI-Outputs nicht immer der Vorstellung entsprachen, wurden bei einigen Visualisierungen Referenzbilder eingesetzt, um die Vision durchzusetzen: gewünschte Proportionen, korrekte Perspektive, plausible Lichtsetzung, bestimmte Kameraführung oder Set-Styling. Das war ein wichtiger Punkt, weil er die Co-Creation realistisch zeigt: Der Mensch kuratiert nicht nur Ergebnisse, sondern verhandelt aktiv mit dem System – und greift ein, wenn die KI „zu frei" oder „zu falsch" wird.

6. Output-Typen pro Konzept bei Visualisierungen

Für jedes Konzept wurden in der Regel Produktshots (fotografisch wirkende Einzelbilder) und Commercials/Animationen (Bewegtbild) erstellt. Damit ließ sich testen, wie stark die Wirkung von einem „hero shot" versus einer narrativen Inszenierung abhängt – und wie sich KI in beiden Medien verhält.

Tool-Stack und Medienproduktion

Die Visualisierungen erfolgten zumeist mit Nano Banana und Nano Banana Pro, wobei Bewegtbild überwiegend über VEO 3.1 erzeugt wurde. In der Projektlogik waren diese Tools keine „Effektmaschinen", sondern Produktionsmittel innerhalb eines kuratierten Prozesses: Moodboard → Textprompt → Output → Auswahl → Nachsteuerung → erneuter Output.

Der entscheidende operative Befund: Der Vorgang brauchte viele Interaktionen. KI erspart zwar oft die manuelle Erstellung, aber sie ersetzt diese nicht 1:1 durch einen einzigen Klick. Stattdessen entsteht ein neuer Arbeitsaufwand: Prompting, Variantenmanagement, Auswahlentscheidungen, Korrekturschleifen und Konsistenzarbeit. Das ist wichtig, weil es zeigt, dass „Zeitersparnis" nicht automatisch „weniger Arbeit" bedeutet, sondern häufig „andere Arbeit".

KI im Produkt Design Prozess

.png)

DER KI-WIRKUNGSGRAD IM DESIGNPROZESS

DIE EVOLUTION DER DESIGN-VISUALISIERUNG

Die Art und Weise, wie Designkonzepte visualisiert werden, durchläuft derzeit den radikalsten Wandel seit Jahrzehnten. Noch vor 20 bis 30 Jahren prägten zeitintensive Marker-Renderings den Arbeitsalltag von Designern. Mit der Einführung von CAD-Programmen und Rendering-Tools wie KeyShot – dem heutigen Industriestandard – wurden diese analogen Techniken weitgehend digitalisiert. Heute stehen wir an einer neuen Schwelle: Künstliche Intelligenz ermöglicht es erstmals, einfache 2D- oder 3D-Skizzen ohne den Umweg über komplexe CAD-Modellierung in fotorealistische Konzepte zu transformieren.

HYPOTHESE UND EXPERIMENTELLE UNTERSUCHUNG

Die zentrale Hypothese dieser Untersuchung lautet, dass öffentlich zugängliche KI-Modelle – wie das in Google Gemini integrierte Nano Banana – eine radikale Prozessoptimierung in der Visualisierungsphase bewirken. Um dies zu überprüfen, wurde eine Datenerhebung durchgeführt, bei der acht unterschiedliche Skizzen von "Incent Holdern" (Räucherstäbchenhaltern) als Basis dienten. Die methodische Eingabe erfolgte über einen simplen Prompt: "Visualisiere mir bitte diese Incent Holder Skizzen fotorealistisch". Der gesamte Prozess der Visualisierung beanspruchte für alle acht Varianten lediglich circa 25 Sekunden.

ERGEBNISANALYSE: DIE VERSCHIEBUNG DES FLASCHENHALSES

Das Experiment bestätigt die Hypothese einer massiven Zeitersparnis. Dabei trat eine überraschende Erkenntnis zutage: Der technologische Shift verschiebt den "Flaschenhals" im Designprozess. Nicht mehr die visuelle Ausarbeitung der Details ist der zeitintensivste Faktor, sondern die Erstellung der initialen Skizze selbst. Noch während meines Studiums der Produktgestaltung im Jahr 2020 wäre es unvorstellbar gewesen, dass Werkzeuge die klassische Rendering-Software nahezu obsolet machen könnten. Dass KI nun in Sekundenschnelle anpassbare Ergebnisse liefert, markiert einen historischen Wendepunkt in der Gestaltung.

KRITISCHE BETRACHTUNG: PRÄZISION VS. EFFIZIENZ

Trotz der Geschwindigkeitsvorteile zeigt die Untersuchung auch die aktuellen Grenzen der Technologie auf. Es besteht eine signifikante Instabilität in der KI-Interpretation: Abweichungen: Die Ergebnisse weichen teilweise stark vom Original ab. Logikfehler: Die räumliche Logik der Skizzen wird von der KI oft nur grob erfasst oder fehlerhaft interpretiert.

DISKUSSION: DIE ZUKUNFT HANDWERKLICHER FÄHIGKEITEN

Diese Entwicklung führt zu einer grundlegenden Debatte innerhalb der Designlehre: Wenn die KI den Großteil der exekutiven, handwerklichen Arbeit übernimmt, stellt sich die Frage, inwieweit das Erlernen traditioneller Techniken wie Marker-Renderings im Studium noch zeitgemäß ist. Während die Effizienz steigt, muss das Berufsbild des Designers neu definiert werden – weg vom rein ausführenden "Visualisierer", hin zum strategischen Kurator von KI-Outputs.

PROZESS 2: KI ALS KATALYSATOR FÜR DIE KONZEPTGENERIERUNG UND ITERATION

Grundgedanke: Hilfe bei der Variantenbildung?

Die zentrale Fragestellung lautet: Kann uns KI bei der Generierung von neuen Konzeptvariationen helfen und wie lässt sie sich effektiv in die Phase der Konzeptionierung einbinden? Hypothese: Im Designprozess ist die Entwicklung verschiedener Konzepte mit einer hohen kognitiven Leistung verbunden, da Designer oft zeitlich limitiert sind und "auf Knopfdruck" kreativ sein bzw. einen hohen Output generieren müssen. Das Ziel dieser Untersuchung ist es herauszufinden, ob es möglich ist, mithilfe von KI schnell und effizient qualitative Konzeptvariationen zu erzeugen.

Experiment: Handlung und Beschreibung

Um die KI (hier: Nano Banana) gezielt als Design-Partner einzusetzen, konzentrierte sich die Handlung des Experiments auf die strategische Promptkonzipierung. Zu Beginn ging es darum herauszufinden, welche Prompts die besten Ergebnisse liefern. Wir haben uns daher für eine modulare Prompt-Architektur entschieden. Dieser Aufbau ermöglicht es, schnell Änderungen vorzunehmen und verschiedene Parameter ohne kompletten Textneuentwurf zu testen. Das Herzstück bildet dabei unser „Hero Prompt": „Professional industrial design product photography of a {{FORM}} desk organizer tray. The object is made of {{MATERIAL}} with a {{FINISH}} surface. It features {{KEY_FEATURES}}. The design language is {{STYLE}}. High-end studio lighting, top-down perspective, minimalist desk setup background, 8k resolution, photorealistic."

Methodik und Durchführung

Durch das systematische Variieren der Platzhalter (Variablen) konnten in kürzester Zeit unterschiedlichste Designrichtungen exploriert werden. Dieser Ansatz transformiert die KI in ein effizientes Werkzeug für die Variantenbildung, da die mentale Transferleistung der visuellen Neuerfindung teilweise an die Maschine delegiert wird.

Kritische Reflexion und Grenzen der Technologie

Trotz der beeindruckenden Geschwindigkeit und der massiven Entlastung bei der Output-Generierung zeigt die Untersuchung auch qualitative Schwächen auf: Instabilität: Die KI-Interpretation bleibt oft unvorhersehbar. Teilweise weichen die Ergebnisse stark von der intendierten Logik des Prompts ab.

PROZESS 3: VOM PROMPT ZUM PRODUKT – KI UND DIE DEMOKRATISIERUNG DER FERTIGUNG

Grundgedanke: Der Kerzenhalter als Proof-of-Concept

In diesem Prozess wird am Beispiel eines Kerzenhalters aufgezeigt, wie künstliche Intelligenz den klassischen Designprozess nicht nur unterstützt, sondern als Kreativ-Katalysator radikal verkürzt. Ziel ist die lückenlose Kette: von der rein textlichen Eingabe (Prompt) bis hin zum physisch gedruckten Produkt.

Hypothese: Expertenwissen „Out of the Box"

Die Hypothese lautet: „Durch die Symbiose von generativer KI und automatisierter Logik wird professionelles Produktdesign zum Allgemeingut." Der technologische Vorsprung von Experten gegenüber Laien schrumpft gegen Null, da die KI-Architektur den ästhetischen Geschmack und das technische Fachwissen für jeden Nutzer sofort verfügbar macht. Die KI fungiert hierbei als Brücke zwischen der Idee im Kopf und dem fertigen Objekt im 3D-Drucker.

Experiment: Die modulare Kette zur Hardware

Die Datenerhebung basierte auf einer gezielten Promptkonzipierung, um verwertbare Konzepte für die additive Fertigung (3D-Druck) zu generieren. Handlung: Einsatz einer modularen Prompt-Architektur, die es erlaubt, formale Parameter des Kerzenhalters blitzschnell anzupassen. Beschreibung: Durch die flexible Architektur wurde versucht, Designs zu generieren, die sowohl ästhetisch anspruchsvoll als auch theoretisch druckbar sind.

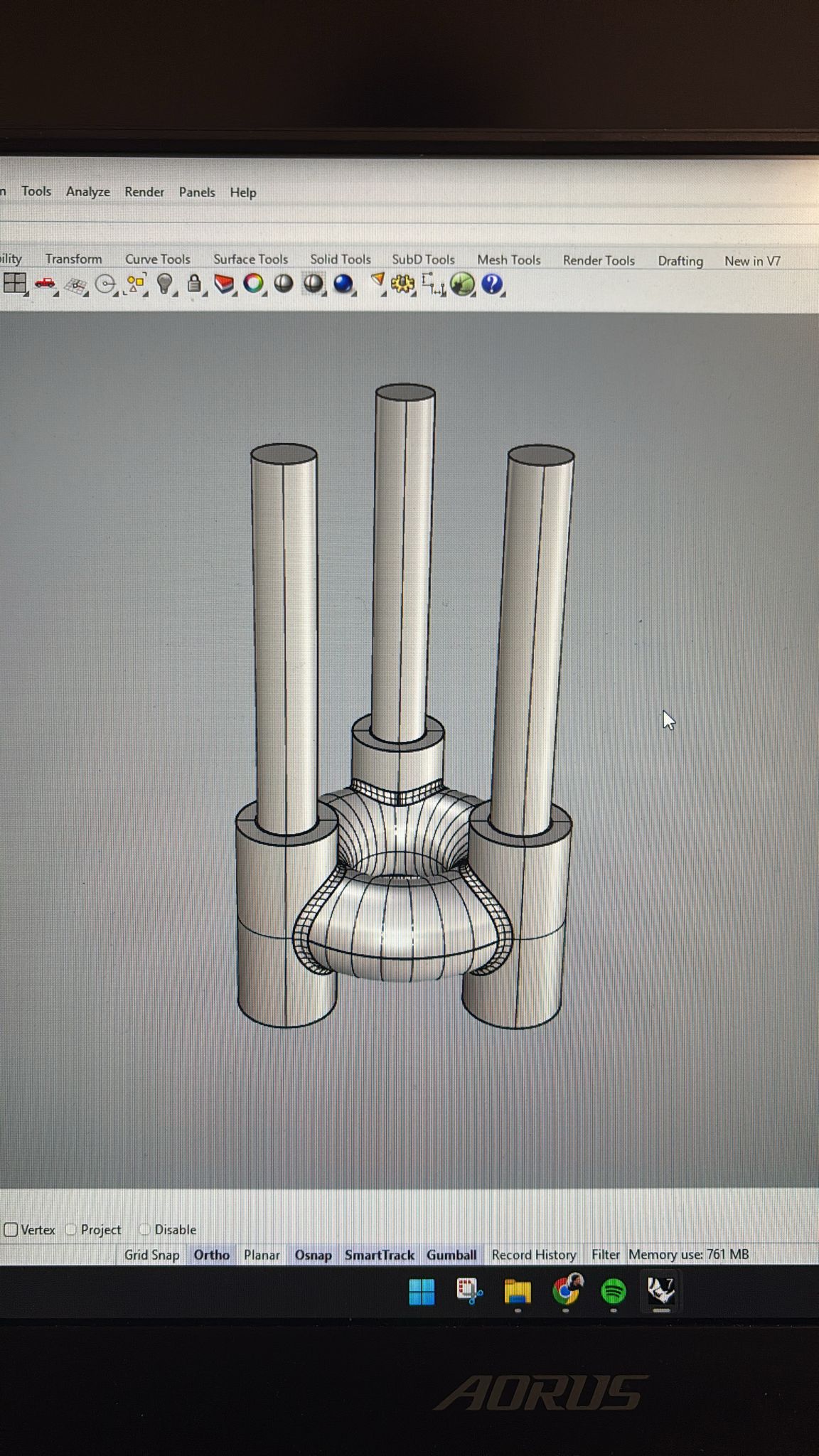

Bestätigung, Erkenntnis und Kritik

Der Übergang vom Prompt zur Visualisierung und zur konzeptionellen Herleitung funktionierte überraschend reibungslos. Die KI konnte hochwertige ästhetische Entwürfe liefern, die professionellen Standards entsprechen. Die entscheidende Hürde zeigte sich jedoch beim Transfer vom 2D-Bild zur 3D-Generierung (STL/Mesh) für den Drucker: Geometriefehler: Es entstanden massive Fehler in der räumlichen Logik, die eine automatisierte Fertigung erschweren. Artefakte: Die KI-generierten „Vorschläge" für die dritte Dimension wiesen geometrische Artefakte auf, die manuell nachbearbeitet werden mussten. Fazit: Die KI demokratisiert zwar die kreative Entwurfsphase und macht „professionelles" Design für jeden zugänglich, scheitert aber aktuell noch an der technischen Präzision, die für einen fehlerfreien „Prompt-to-Product"-Workflow ohne menschliches Eingreifen nötig wäre.

KI in visueller Gestaltung und Creative Direction

Konzept 1: Gestalten statt nur Generieren

In SYNCREATE wurde früh klar: KI kann zwar Bilder erzeugen, aber sie übernimmt keine Bildsprache. Deshalb begann die visuelle Arbeit nicht beim Output, sondern bei der Entscheidung, wie ein Produkt „gesehen werden soll". Für die Räucherstäbchen des ersten Konzeptes wurden visuelle Parameter festgelegt – einmal gängige Produktbilder (bspw. Natur-Setting, Studio-Setting) und surreale Darstellungen. Diese Bildentscheidungen wurden in Moodboards übersetzt und anschließend als klare Prompt-Bausteine formuliert. Das Prompting beinhaltete mehrere Parameter wie Aperture, ISO-Einstellung, Lichteinstellungen und Perpektiven. So entstand ein visuelles Regelwerk, das die KI nicht ersetzt, sondern gezielt lenkt: Der Output wird dadurch weniger zufällig und stärker zu einer gestalterisch begründeten Visualisierung.

Konzept 2: Konsistenz und Iteration

Beim Konzept 2 wurden Desk Organizer einerseits anhand eines Prompt-Musters erstellt, andererseits visuell in Szene anhand eines Videos im Commercial Stil präsentiert. Mit dem Variantenreichtum der KI entstand gleichzeitig ein zentrales Problem: stilistische Drift. Einzelne Ergebnisse wirkten plötzlich wie aus einer anderen Kamera, mit anderem Objektiv, anderem Set oder sogar anderer Materiallogik. Um Serienfähigkeit herzustellen, wurde mit wiederkehrenden „Ankern" gearbeitet – festen Lichtbeschreibungen, wiederholten Prompt-Segmenten und einer konstanten Darstellungslogik. Wo die KI dennoch zu viele interpretative Freiheiten nahm (z. B. falsche Materialwirkung oder unplausible Proportionen), sind in den Videoclips Glitches entstanden. Der Prozess blieb iterativ – nicht als einmalige Eingabe, sondern als wiederholtes Nachschärfen, bis Bildlogik, Produktidee und Wirkung zusammenpassten. Das endgültige Commercial-Video wurde in Nodes zusammengeführt.

Konzept 3: Inszenierung und Ausstellung

Im finalen Konzept wurde der Output nicht nur gesammelt, sondern als Erzählung organisiert. Die statistischen Visualisierungen des Kerzenhalters erhielten nach der Creative Direction ein Editorial Look and Feel – hochwertig, jedoch zwanglos im Alltag inszeniert. Die Visuals sind zumeist durch Nano Banana Pro mit der Referenz des 3D-Renderings entstanden, wodurch sich die Qualität des Outputs deutlich erhöhte. Die zuvor ausprobierten Modelle von Krea missverstanden die Renderings des Kerzenhalters und verwandelten die Szenerie in Küchenpapier-Rollen statt des Kerzenhalters.

Bewegtbild spielte dabei eine zentrale Rolle: Im Commercial wird nicht nur der Kerzenhalter gezeigt, sondern eine Wertwelt gebaut – über Tempo, Kamerafahrten und Fokuswechsel. Hier zeigte sich die Stärke von VEO 3.1 als schnelles Pitch-Film-Werkzeug, aber auch die Notwendigkeit, Dramaturgie über präzise Prompts und Iterationen zu stabilisieren. Das Endprodukt des Videoformats wurde mithilfe von Nodes angepasst und zusammengeschnitten.

Parallel dazu entstand die Ausstellung als kuratierter Lernraum: Aus vielen Outputs musste eine Reihenfolge werden, die Sinn erzeugt. Deshalb wurden bewusst auch Prompts, Fehlversuche und Iterationslogiken sichtbar gemacht, damit Besucher*innen nachvollziehen konnten, warum ein Bild „so" aussieht – und wie viel Steuerung dahinter steckt. Die Leitfrage „Was bleibt menschlich…?" fungierte nicht als dekorativer Claim, sondern als Auswahlkriterium: Welche Artefakte zeigen menschliche Entscheidung, wo wird KI sichtbar, wo verschwindet sie? Die Creative Direction bündelte all das zu einer stimmigen Gesamterzählung, in der Poster, Videos, Prozessdokumentation und Raumgestaltung zusammenpassen mussten: ruhig genug, um den Fokus aufs Produkt zu halten, und gleichzeitig lebendig genug, um den Studiocharakter der Co-Creation erfahrbar zu machen.

Für jedes Produktdesign-Konzept wurde entschieden, wie es „gesehen werden soll": neutraler Studio-„Catalog Shot" vs. emotionaler Lifestyle-Kontext, Top-Down vs. 3/4-Perspektive, harte Produktlichtkante vs. weiches diffuses Licht, Minimal Desk Setup vs. atmosphärisches Interior. Diese Entscheidungen wurden als Parameter in Moodboards und Prompts gegossen.

Konsistenz über Varianten hinweg

Ein Hauptproblem generativer Bildmodelle ist stilistische Drift: Varianten sehen plötzlich nach anderer Kamera, anderem Objektiv oder anderem Set aus. Die visuelle Gestaltung arbeitete daher mit wiederkehrenden „Ankern": wiederholte Prompt-Segmente, fixe Lichtbeschreibungen, gleiche Hintergrundlogik – damit eine Serie wie eine Serie wirkt.

Referenzbilder als „Visions-Verstärker"

Wenn KI zu viele interpretative Freiheiten nahm (z. B. falsche Materialwirkung, unplausible Proportionen), wurden Referenzbilder eingesetzt. Wichtig ist dabei die Erkenntnis: Referenzen waren nicht „Cheating", sondern Teil des kreativen Workflows, um das Verhältnis von Kontrolle (Mensch) und Variation (KI) produktiv zu balancieren.

Bewegtbild als Inszenierung von Produktwert

In Commercials/Animationen wird nicht nur ein Produkt gezeigt, sondern eine Wertwelt gebaut: Tempo, Kamerafahrten und Fokuswechsel. Gerade hier zeigte sich die Stärke von VEO 3.1 als schnelles „Pitch-Film"-Werkzeug – und zugleich die Notwendigkeit, die Bilddramaturgie durch präzise Prompts und Iterationen zu stabilisieren.

Im Sinne der Ausstellung musste kuratiert werden, wie aus vielen Outputs eine Ausstellung wird, die Sinn erzeugt. Kuratorisch wurde bewusst darauf geachtet, auch Prompts, Fehlversuche und Iterationslogik zu zeigen. Damit wurde die Ausstellung zu einem Lernraum: Besucher*innen konnten nachvollziehen, warum ein Bild „so" aussieht – und wie viel Steuerung dahinter steckt. Die Leitfrage „Was bleibt menschlich…?" wurde nicht als Textplakat verstanden, sondern als Auswahlkriterium: Welche Artefakte zeigen menschliche Entscheidung? Wo wird KI sichtbar? Wo verschwindet sie? Diese Fragen strukturierten die Exponatauswahl.

Die Creative Direction bündelte das Projekt zu einer stimmigen Gesamterzählung: Warum diese Produkte? Warum diese Bildsprache? Warum diese Ausstellung als Mini-Studio? Poster, Videos, Prozessdokumentation und Raumgestaltung mussten zusammenpassen: stilistisch zusammenpassend, um den Fokus aufs Produkt zu halten, und lebendig genug, um den Studiocharakter zu zeigen.